научное издание МГТУ им. Н.Э. Баумана

НАУКА и ОБРАЗОВАНИЕ

Издатель ФГБОУ ВПО "МГТУ им. Н.Э. Баумана". Эл № ФС 77 - 48211. ISSN 1994-0408

# 08, август 2011

DOI: 10.7463/0811.0204143

УДК 519.6

МГТУ им. Н.Э. Баумана

Введение

Во многих приложениях, в которых модели исследуемых объектов представляют в виде обыкновенных дифференциальных уравнений (ОДУ), возникает задача построения области достижимости соответствующей динамической системы. Например, такая задача возникает при решении проблемы траекторной безопасности летального аппарата [1], при решении близкой задачи о посадке вертолета на подвижный носитель [2].

Важной особенностью задачи построения области достижимости является то, что ее часто приходится решать в режиме реального времени. При этом основные вычислительные затраты обусловлены затратами на интегрирование указанной системы ОДУ. Таким образом, актуальной является задача быстрого интегрирования модельной системы ОДУ.

Известно несколько подходов к построению области достижимости динамической системы. Прежде всего, возможно точное аналитическое построение этой области. Однако такой подход возможен лишь в простейших случаях, не представляющих практического интереса. Поэтому для построения этой области обычно приходится использовать приближенные численные методы. Среди этих методов выделим

· метод мультифиниша,

· нейросетевые методы.

Основная идея метода мультифиниша состоит в многократном численном интегрировании модельной системы ОДУ при различных допустимых управлениях [3]. Метод хорошо распараллеливается, как для MIMD, так и для SIMD многопроцессорных вычислительных систем [4, 5].

Нейросетевые методы приближенного построения области достижимости ориентированы на аппроксимацию нейронными сетями непосредственно границы этой области [7].

Можно предложить значительное число вариантов метода мультифиниша. Так, возможна комбинация этого метода с методом аппроксимации векторного поля модельной системы ОДУ. Суть такой комбинации заключается в предварительной аппроксимации правых частей модельной системы ОДУ с помощью, например, локальной кусочно-постоянной и локальной кусочно-линейной интерполяции, глобальной полиномиальной аппроксимации [6]. В данной работе рассматривается нейросетевая аппроксимация правых частей модельной системы ОДУ.

В первом разделе работы приводится постановка задачи построения области достижимости для системы ОДУ седьмого порядка, описывающей движение центра масс летательного аппарата. Во втором разделе рассмотрены используемые далее нейронные сети. Третий и четвертый разделы посвящены исследованию эффективности нейросетевой аппроксимации векторного поля указанной системы ОДУ. Пятый раздел посвящен исследованию некоторых способов повышения точности аппроксимации, которые приводят к использованию ансамблей нейронных сетей, включающих в себя число сетей, превышающее порядок модельной системы ОДУ. В заключении сформулированы основные результаты работы и очерчены перспективы ее развития.

Все вычислительные эксперименты, результаты которых приведены в работе, выполнены с помощью программной системы Matlab7 R2009 [8, 9].

1. Постановка задачи

Рассмотрим динамическую систему седьмого порядка

(1)

(1)

описывающую движение центра масс летательного аппарата [1], где g=9,81 м/с2 — ускорение свободного падения.

Фазовыми переменными системы являются ![]() — скорость летательного аппарата;

— скорость летательного аппарата; ![]() — угол поворота траектории;

— угол поворота траектории; ![]() — угол наклона траектории;

— угол наклона траектории; ![]() — угол крена;

— угол крена; ![]() ,

, ![]() ,

,![]() — координаты центра масс аппарата в земной системе координат, где y – его высота.

— координаты центра масс аппарата в земной системе координат, где y – его высота.

Если не оговорено иное, используем следующие ограничения на указанные фазовые переменные:

![]() ,м/с;

,м/с; ![]() ,м/с;

,м/с;

![]() ,

, ![]() ;

;

![]() ,

, ![]() ;

;

![]() ,

, ![]() ;

;

![]() 1500 м,

1500 м, ![]() 4500 м;

4500 м;

![]() 500 м,

500 м, ![]() 3500 м;

3500 м;

![]() м,

м, ![]() м.

м.

Здесь ![]() ,м/с − скорость звука в воздухе.

,м/с − скорость звука в воздухе.

Управлениями летательного аппарата являются нормальная перегрузка n, тангенциальная перегрузка ![]() и скорость изменения угла крена

и скорость изменения угла крена ![]() . На управления, полагаем, наложены ограничения

. На управления, полагаем, наложены ограничения

(2)

(2)

Последняя компонента управления принимает значение ![]() , рад/c при необходимости увеличения угла крена и

, рад/c при необходимости увеличения угла крена и ![]() , рад/c − при необходимости его уменьшения.

, рад/c − при необходимости его уменьшения.

Движение системы рассматриваем на интервале времени ![]() , где

, где ![]() - начальный момент времени,

- начальный момент времени, ![]() – продолжительность полета. Полагаем заданными начальные значения фазовых переменных системы (1), т.е. значения величин

– продолжительность полета. Полагаем заданными начальные значения фазовых переменных системы (1), т.е. значения величин ![]() ,

, ![]() ,…,

,…,![]() .

.

Областью достижимости летательного аппарата (ОДЛА) назовем множество всех возможных значений вектора ![]() , которые могут быть получены на решениях системы (1) при заданных допустимых начальных условиях

, которые могут быть получены на решениях системы (1) при заданных допустимых начальных условиях ![]() ,

, ![]() ,…,

,…,![]() и выполнении ограничений (2) на компоненты вектора управления.

и выполнении ограничений (2) на компоненты вектора управления.

Очевидно, что ОДЛА полностью определяет ее граница. В работе [1] получены структуры управлений, приводящих летательный аппарат (1) на эту границу при фиксированном угле крена (когда ![]() ). Указанные управления являются кусочно-постоянными, имеют не более одной точки переключения и определяются выражениями:

). Указанные управления являются кусочно-постоянными, имеют не более одной точки переключения и определяются выражениями:

− для дальней границы ОДЛА

![]() ; (3)

; (3)

− для ближней границы

![]() ; (4)

; (4)

− для боковой границы

![]() ,

,  (5)

(5)

Здесь ![]() ,

, ![]() ,

, ![]() − моменты переключения управлений, обеспечивающие достижение летательным аппаратом указанных границ ОДЛА.

− моменты переключения управлений, обеспечивающие достижение летательным аппаратом указанных границ ОДЛА.

Положим, что ![]() — погрешность аппроксимации функции

— погрешность аппроксимации функции ![]() в i-ой точке тестового множества. Здесь

в i-ой точке тестового множества. Здесь ![]() ,

, ![]() - точное и приближенное значения функции

- точное и приближенное значения функции ![]() в указанной точке;

в указанной точке; ![]() ,

, ![]() ;

; ![]() ; K — мощность тестового множества.

; K — мощность тестового множества.

Используем следующие меры точности аппроксимации:

− средняя абсолютная погрешность

;

;

− средняя квадратичная погрешность (mean square error)

;

;

− максимальная абсолютная погрешность

![]() ;

;

− средняя относительная погрешность

.

.

2. Типы используемых нейронных сетей

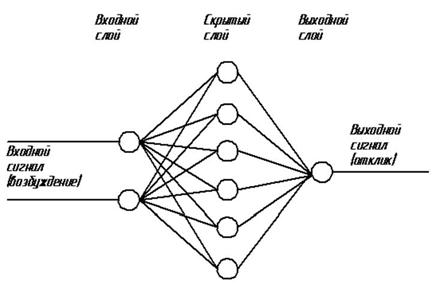

Используем для аппроксимации функции ![]() два типа многослойных нейронных сетей − трехслойную опережающую сеть с прямым распространением сигнала (Feed-Forward Network - FFN) и аналогичную каскадную сеть (Cascade Neural Network – CNN);

два типа многослойных нейронных сетей − трехслойную опережающую сеть с прямым распространением сигнала (Feed-Forward Network - FFN) и аналогичную каскадную сеть (Cascade Neural Network – CNN); ![]() ,

, ![]() [10]. Структуры указанных сетей приведены на рисунках 1, 2.

[10]. Структуры указанных сетей приведены на рисунках 1, 2.

Рисунок 1 – Структура трехслойной FFN-сети

Входной слой сетей FFN , CNN состоит из числа нейронов, равного размерности задачи. В выходном слое во всех случаях используем один нейрон с линейной функцией активации. Нейроны скрытого слоя имеют сигмоидальные функции активации. Число этих нейронов является свободным параметром сетей и подбирается, исходя из требуемой точности аппроксимации.

Рисунок 5 – Структура трехслойной CNN-сети

Для обучения ![]() -и

-и ![]() -сетей используем алгоритм обратного распространения ошибки со средним квадратичным отклонением MSE в качестве ошибки обучения.

-сетей используем алгоритм обратного распространения ошибки со средним квадратичным отклонением MSE в качестве ошибки обучения.

3. Аппроксимация с помощью FFN-сетей

Рассмотрим прежде вариант аппроксимации каждого из уравнений ![]() своей

своей ![]() -сетью (так что общее число нейронных сетей равно пяти);

-сетью (так что общее число нейронных сетей равно пяти); ![]() ,

, ![]() .

.

3.1. Зависимость ошибки обучения от начальных условий. Используем в качестве примера функцию

![]() . (6)

. (6)

Покроем интервалы ![]() ,

, ![]() равномерными сетками

равномерными сетками ![]() ,

, ![]() с

с ![]() и

и ![]() узлами соответственно. Значения функции

узлами соответственно. Значения функции ![]() в узлах сетки

в узлах сетки ![]() используем в качестве обучающей выборки.

используем в качестве обучающей выборки.

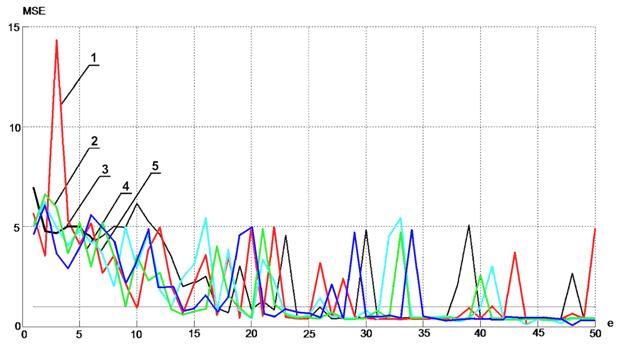

Хорошо известно, что характер сходимости процесса обучения нейронной сети и сам результат обучения, могут сильно зависеть от начальных значений весовых коэффициентов нейронной сети. Эффект иллюстрирует рисунок 3, на котором показана зависимость ошибки обучения ![]() от номера эпохи (epoch) обучения e для пяти случайных наборов весовых коэффициентов.

от номера эпохи (epoch) обучения e для пяти случайных наборов весовых коэффициентов.

Эксперименты выполнены при ![]()

![]() , так что общее число узлов сетки

, так что общее число узлов сетки ![]() равно 400 (мощность обучающей выборки K=400). В качестве тестовой выборки использованы

равно 400 (мощность обучающей выборки K=400). В качестве тестовой выборки использованы ![]() случайных точек, равномерно распределенных в прямоугольнике

случайных точек, равномерно распределенных в прямоугольнике ![]()

![]() (так что мощность тестовой выборки также равна 400). Максимальное число эпох обучения e принято равным 50.

(так что мощность тестовой выборки также равна 400). Максимальное число эпох обучения e принято равным 50.

1, 2,…,5 – номера случайных наборов весовых коэффициентов

Рисунок 3 − К зависимости ошибки обучения ![]() нейронной сети

нейронной сети ![]() от начальных значений ее весовых коэффициентов

от начальных значений ее весовых коэффициентов

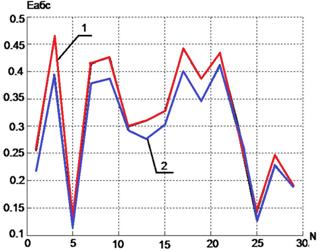

3.2. Варьирование чисел нейронов и эпох обучения. Результаты исследования зависимости ошибки ![]() -аппроксимации функции

-аппроксимации функции ![]() от числа нейронов в сети иллюстрируют рисунки 4, 5. Во всех случаях обучение производилось 10 раз, исходя из случайных начальных значений весовых коэффициентов. В качестве результата обучения принималась нейронная сеть, обеспечивающая минимальное значение MSE. Исследование выполнено с использованием указанных выше обучающей и тестовой выборок.

от числа нейронов в сети иллюстрируют рисунки 4, 5. Во всех случаях обучение производилось 10 раз, исходя из случайных начальных значений весовых коэффициентов. В качестве результата обучения принималась нейронная сеть, обеспечивающая минимальное значение MSE. Исследование выполнено с использованием указанных выше обучающей и тестовой выборок.

Аналогичные результаты получены также для остальных уравнений системы (1) − таблица 1.

1 − тестовая выборка; 2 − обучающая выборка

Рисунок 4 − MSE-ошибка аппроксимации функции ![]() сетью

сетью ![]() в зависимости от числа нейронов скрытого слоя N

в зависимости от числа нейронов скрытого слоя N

1 − тестовая выборка; 2 − обучающая выборка

Рисунок 5 − Ошибка ![]() аппроксимации функции

аппроксимации функции ![]() сетью

сетью ![]() в зависимости от числа нейронов скрытого слоя N

в зависимости от числа нейронов скрытого слоя N

Результаты исследования показывают, что при фиксированной мощности K обучающего множестве не удается путем варьирования числа нейронов в скрытом слое ![]() -сети обеспечить для всех уравнений системы (1) близкую точность аппроксимации. Точнее говоря, минимальное достигнутое значение ошибки

-сети обеспечить для всех уравнений системы (1) близкую точность аппроксимации. Точнее говоря, минимальное достигнутое значение ошибки ![]() изменяется в условиях исследования от величины 0,01 для функций

изменяется в условиях исследования от величины 0,01 для функций ![]() ,

, ![]() до величины 0,5 для функций

до величины 0,5 для функций![]() ,

, ![]() (в 50 раз!). При этом оптимальное число нейронов в скрытом слое изменяется от пяти до 20, а оптимальное число эпох обучения – от 40 до 58.

(в 50 раз!). При этом оптимальное число нейронов в скрытом слое изменяется от пяти до 20, а оптимальное число эпох обучения – от 40 до 58.

Таблица 1 – Результаты исследования эффективности FFN-аппроксимации векторного поля динамической системы (1)

Функция |

|

|

|

| 0,1 | 5 | 40 |

| 0,01 | 5 | 58 |

| 0,01 | 5 | 58 |

| 5,0 | 20 | 42 |

| 5,0 | 20 | 40 |

| 5,0 | 20 | 42 |

3.3. Варьирование мощности обучающей выборки. Рассмотрим в качестве примера функцию

![]() . (7)

. (7)

Аналогично тому, как этот сделано выше, покроем интервалы ![]() ,

, ![]() равномерными сетками

равномерными сетками ![]() ,

, ![]() с

с ![]() и

и ![]() узлами соответственно, так что мощность обучающей выборки равна

узлами соответственно, так что мощность обучающей выборки равна ![]() .

.

Эффективность увеличения мощности обучающей выборки Kиллюстрирует таблица 2. Таблица показывает, что увеличение этой мощности приводит к уменьшению, хотя и медленному, указанных в таблице ошибок аппроксимации. Так переход от ![]() к

к ![]() (увеличение значения K более чем в 40 (!) раз) приводит снижению MSE с 6,2 до 2,6 (всего лишь несколько более чем в два раза). Отметим, что увеличение мощности обучающей выборки K вызывает быстрый рост вычислительных затрат на обучение нейронной сети.

(увеличение значения K более чем в 40 (!) раз) приводит снижению MSE с 6,2 до 2,6 (всего лишь несколько более чем в два раза). Отметим, что увеличение мощности обучающей выборки K вызывает быстрый рост вычислительных затрат на обучение нейронной сети.

Таблица 2 – К эффективности увеличения мощности обучающей выборки при аппроксимации функции ![]() :

:

ОВ − обучающая выборка, ТВ – тестовая выборка

Мощность выборки K |

|

|

| |||

ОВ | ТВ | ОВ | ТВ | ОВ | ТВ | |

49 | 6,2 | 13,1 | 6,9 | 10,6 | 7,7 | 25,0 |

225 | 4,6 | 5,9 | 6,7 | 7,6 | 6,8 | 11,0 |

900 | 3,2 | 3,6 | 4,5 | 4,8 | 4,4 | 6,1 |

2025 | 2,6 | 2,9 | 3,6 | 3,7 | 3,4 | 4,2 |

4. Аппроксимация с помощью CNN-сетей

Аппроксимируем каждое из уравнений ![]() с помощью своей

с помощью своей ![]() -сети (так что общее число нейронных сетей также, как в разделе 3, равно пяти);

-сети (так что общее число нейронных сетей также, как в разделе 3, равно пяти); ![]() ,

, ![]() .

.

Рассмотрим в качестве примера уравнение

![]() . (8)

. (8)

Покроем интервалы ![]() ,

, ![]() ,

, ![]() равномерными сетками

равномерными сетками ![]() ,

, ![]() ,

, ![]() с

с ![]() ,

, ![]() и

и ![]() узлами соответственно, так что мощность обучающей выборки равна

узлами соответственно, так что мощность обучающей выборки равна ![]() .

.

Исследование эффективности CNN-сети выполнено в области ![]() м,

м, ![]() ,

, ![]() на сетке с

на сетке с ![]() узлами при числе нейронов в скрытом слое, равном 20.

узлами при числе нейронов в скрытом слое, равном 20.

Результаты исследования показывают, что CNN-сеть обеспечивает при прочих равных условиях примерно в два раза меньшую среднюю квадратичную ошибку аппроксимации по сравнению с FFN-сетью. Так по результатам пяти экспериментов с различными начальными значениями весовых коэффициентов FFN-сеть обеспечила минимальную ошибку, равную 9,0. CNN-сеть в тех же условиях обеспечила ту же ошибку, равную 3,2.

Отметим, что указанное уменьшение погрешности аппроксимации каскадная нейронная сеть обеспечивает практически без увеличения времени ее обучения.

5. Повышение эффективности аппроксимации

5.1. Учет релейности управлений. Поскольку, в конечном счете, аппроксимацию векторного поля динамической системы (1) предполагаем использовать для построения границ ОДЛА, задачу аппроксимации можно упростить.

Рассмотрим опять для примера функцию (6) и положим, что речь идет об аппроксимации ближней границы ОДЛА, когда управление ![]() должно принимать только значения

должно принимать только значения ![]() ,

, ![]() (формула (4)). На этом основании перейдем от аппроксимации функции двух аргументов

(формула (4)). На этом основании перейдем от аппроксимации функции двух аргументов ![]() к аппроксимации двух функций одного аргумента

к аппроксимации двух функций одного аргумента

![]() ,

, ![]() .

.

Используем для аппроксимации каждой из этих функций свою FFN-сеть, т.е. применим для аппроксимации функции ![]() ансамбль из двух сетей

ансамбль из двух сетей ![]() ,

, ![]() .

.

Результаты исследования показывает, что, как и следовало ожидать, учет релейности управления позволяет значительно уменьшить ошибку аппроксимации MSE. Так для нейронных сетей с пятью нейронами в скрытом слое и прочих равных условиях аппроксимация функции ![]() обеспечивает MSE=0,00012, а аппроксимация функции

обеспечивает MSE=0,00012, а аппроксимация функции ![]() − MSE=0,0037 (почти на порядок меньше по сравнению с вариантом, в котором релейность управления не учитывается (!) – раздел 2.1).

− MSE=0,0037 (почти на порядок меньше по сравнению с вариантом, в котором релейность управления не учитывается (!) – раздел 2.1).

Указанные результаты получены при мощности обучающей выборки ![]() , равной 200 для каждой из указанных нейронных сетей. Таким образом, суммарная мощность обучающей выборки, как и в разделе 2.1, принята равной 400.

, равной 200 для каждой из указанных нейронных сетей. Таким образом, суммарная мощность обучающей выборки, как и в разделе 2.1, принята равной 400.

Отметим, что при увеличении мощности обучающей выборки ошибка аппроксимации MSE уменьшается очень медленно. Так при ![]() эта ошибка уменьшается всего лишь до величины 0,00008.

эта ошибка уменьшается всего лишь до величины 0,00008.

Представляет интерес то обстоятельство, что время на обучение сети ![]() на выборке из 400 элементов в 1,2 раза превышает суммарное время обучения нейронных сетей

на выборке из 400 элементов в 1,2 раза превышает суммарное время обучения нейронных сетей ![]() ,

, ![]() с той же суммарной мощностью выборки.

с той же суммарной мощностью выборки.

Отметим также, что при использовании данного подхода число нейронных сетей для аппроксимации дальней и ближней границ ОДЛА составляет семь, а боковой границы – восемь. Таким образом, для аппроксимации всех границ ОДЛА при данном подходе требуется 22 нейронных сети.

5.2. Декомпозиция области допустимых значений. Аналогично разделу 3.3 рассмотрим функцию (8). Увеличить точность нейросетевой аппроксимации возможно за счет декомпозиции области допустимых значений аргументов этой функции

![]()

![]()

![]()

на ряд непересекающихся подобластей ![]() ,

, ![]() ,…,

,…,![]() таких, что

таких, что  .

.

Эффективность данного приема демонстрируем для четырех подобластей равного объема ![]() :

:

![]()

![]()

![]() ;

;

![]()

![]()

![]() ;

;

![]()

![]()

![]() ;

;

![]()

![]()

![]() .

.

Мощность обучающей выборки для каждой из указанных подобластей принимаем равной ![]() , так что суммарное число узлов сеток

, так что суммарное число узлов сеток ![]() ,

, ![]() , покрывающих подобласти

, покрывающих подобласти ![]() , равно 32000.

, равно 32000.

Для аппроксимации функции ![]() в каждой из подобластей

в каждой из подобластей ![]() ,

, ![]() используем свою каскадную нейронную сеть

используем свою каскадную нейронную сеть ![]() (раздел 2.3) с 20 нейронами в скрытом слое.

(раздел 2.3) с 20 нейронами в скрытом слое.

Результаты исследования показывают, что в указанных условиях декомпозиция области допустимых значений позволяет получить ошибку аппроксимации MSE![]() 5. Без декомпозиции области

5. Без декомпозиции области ![]() на обучающей выборке той же мощности аппроксимация функции (8) аналогичной нейронной сетью с 20 нейронами в скрытом слое позволяет получить MSE

на обучающей выборке той же мощности аппроксимация функции (8) аналогичной нейронной сетью с 20 нейронами в скрытом слое позволяет получить MSE![]() 80. Таким образом, рассмотренная декомпозиция области допустимых значений позволяет уменьшить ошибку аппроксимации MSE примерно в 16 раз. Отметим, что в данном случае суммарное время обучения четырех нейронных сети примерно в четыре раза превышает время обучения одной нейронной сети.

80. Таким образом, рассмотренная декомпозиция области допустимых значений позволяет уменьшить ошибку аппроксимации MSE примерно в 16 раз. Отметим, что в данном случае суммарное время обучения четырех нейронных сети примерно в четыре раза превышает время обучения одной нейронной сети.

Положим, что, как и в рассмотренном примере, интервал допустимых значений каждой из угловых фазовых переменных разделен на два подынтервала. Легко видеть, что в этом случае метод декомпозиции области допустимых значений фазовых переменных требует использования 20 нейронных сетей для аппроксимации всех границ ОДЛА. Аналогично, при использовании комбинации метода учета релейности управления и метода декомпозиции области допустимых значений фазовых переменных аппроксимация дальней границы ОДЛА требует 22 нейронных сетей, ближней границы – также 22 сетей, а боковой границы – 28 сетей. Так что общее число нейронных сетей в этом случае равно 72.

Заключение

Выполнено широкое исследование эффективности нейросетевой аппроксимации векторного поля модельной системы ОДУ при варьировании чисел нейронов и эпох обучения, мощности обучающей выборки, топологии нейронной сети. Рассмотрены два способа повышения эффективности нейросетевой аппроксимации – за счет учета релейности управлений, приводящих на границы области достижимости системы, а также за счет декомпозиции области допустимых значений фазовых переменных системы. Результаты исследования показывают, что нейросетевая аппроксимация векторного поля модельной системы ОДУ в комбинации с методом мультифиниша может быть использована для приближенного построения области достижимости динамической системы.

Задача выбора способа нейросетевой аппроксимации векторного поля является, по сути, многокритериальной. Прежде всего, кроме точности приближения границ множества достижимости следует учитывать процессорной время, необходимое для построения этих границ. Кроме того, может быть необходимым учет требуемого объема оперативной памяти ЭВМ. Поэтому в развитии работы планируется разработка алгоритмического и программного обеспечения для решения задачи нейросетевой аппроксимации векторного поля модельной системы ОДУ как многокритериальной задачи принятия решений.

В продолжении работы имеется в виду также исследование погрешности аппроксимации границ ОДЛА с помощью комбинации методов мультифиниша и нейросетевой аппроксимации векторного поля модельной системы ОДУ подобно тому, как это сделано в работе [6].

Наконец, планируется исследование эффективности нейросетевой аппроксимации на параллельных вычислительных системах различных архитектур, включая графические процессорные устройства.

Литература

1. Воронов, Е.М. Алгоритм оценки границ области достижимости летательного аппарата с учетом тяги / Е.М. Воронов, А.А. Карпунин // Вестник МГТУ. Сер. Приборостроение.- 2007.- ╧4(69).- с. 81-99.

2. Гурман, В.И. Приближенные методы оптимизации управления летальным аппаратом / В.И. Гурман, В.И. Квоков, М.Ю. Ухин // Автоматика и телемеханика.- 2008.- ╧4.- с. 191–201.

3. Воронов, Е.М. Численные методы построения области достижимости динамической системы / Е.М. Воронов, А.П. Карпенко, О.Г. Козлова, В.А. Федин В.А. // Вестник МГТУ им. Н.Э. Баумана, серия «Приборостроение», 2010, ╧2 (79), с. 3-20.

4. Воронов, Е.М. Параллельное построение множества достижимости высокоманевренного летательного аппарата методом «мультифиниша» / Е.М. Воронов, А.П. Карпенко, В.А. Федин // Параллельные вычислительные технологии (ПаВТ’2010): Труды международной научной конференции (Уфа, 29 марта – 2 апреля 2010 г.) [Электронный ресурс] – Челябинск: Издательский центр ЮУрГУ, 2010. – с. 113-120.

5. Витюков, Ф.А. Построение области достижимости динамической системы на NVidea и AMD графических процессорах / Ф.А. Витюков, В.К. Домашнев, А.П. Карпенко, В.А. Федин В.А. // Научный сервис в сети Интернет: суперкомпьютерные центры и задачи Труды международной суперком- пьютерной конференции (21-26 сентября 2009 г., Новороссийск). – М.: Изд-во МГУ, 2010. – с.635-641.

6. Карпенко, А.П. Построение границы области достижимости динамической системы комбинацией методов мультфиниша и аппроксимации векторного поля / А.П. Карпенко, Д.С. Кулеш, В.А. Федин В.А. // Наука и образование: электронное научно- техническое издание, 2011, 5, [Электронный ресурс]. (http://technomag.edu.ru/doc/185335.html).

7. Voronov, E.M. Neuronet approximation of aircraft attainability domain boundary / E.M. Voronov, A.P. Karpenko, O.G. Kozlova, V.A. Fedin, A.G. Trofimov // Optical Memory and Neural Networks (Information Optics), 2010, ╧ 4, с. 291 – 299.

8. Дьяконов, В.П. MATLAB 7.*/R2006/2007. Самоучитель / В.П. Дьяконов.– Москва.: «ДМК-Пресс», 2008.– 768 с.

9. Медведев, В.С. Нейронные сети. Matlab 6 / В.С. Медведев, В.Г. Потемкин.– М.: Диалог-МИФИ, 2001.– 496с.

10. Хайкин, С. Нейронные сети. Второе издание. Полный курс / С. Хайкин. – М: Вильямс, 2008.– 1103 с.

Публикации с ключевыми словами: динамическая система, нейросетевая аппроксимация, метод мультифиниша, область достижимости

Публикации со словами: динамическая система, нейросетевая аппроксимация, метод мультифиниша, область достижимости

Смотри также:

Тематические рубрики:

| Авторы |

| Пресс-релизы |

| Библиотека |

| Конференции |

| Выставки |

| О проекте |

| Телефон: +7 (915) 336-07-65 (строго: среда; пятница c 11-00 до 17-00) |

|

||||

| © 2003-2024 «Наука и образование» Перепечатка материалов журнала без согласования с редакцией запрещена Тел.: +7 (915) 336-07-65 (строго: среда; пятница c 11-00 до 17-00) | |||||